Подходы к трактовке понятия информация

Подходы к понятию информации и измерению информации

Термин информация происходит от латинского information, что означает разъяснение, осведомление, изложение.

В широком смысле информация – это общенаучное понятие, включающее в себя обмен сведениями между людьми, обмен сигналами между живой и неживой природой, людьми и устройствами.

Информация – это сведения об объектах и явлениях окружающей среды, их параметрах, свойствах и состоянии, которые уменьшают имеющуюся о них степень неопределенности, неполноты знаний.

Наряду с информацией в информатике часто употребляется понятие данные.

Данные могут рассматриваться как признаки или записанные наблюдения, которые по каким-то причинам не используются, а только хранятся. В том случае, если появляется возможность использовать эти данные для уменьшения неопределенности о чем-либо, данные превращаются в информацию. Поэтому можно утверждать, что информацией являются используемые данные.

С точки зрения информатики наиболее важными являются следующие свойства информации:

Информация достоверна, если она отражает истинное положение дел. Недостоверная информация может привести к неправильному пониманию или принятию неправильных решений.

Достоверная информация со временем может стать недостоверной, так как она обладает свойством устаревать, то есть перестаёт отражать истинное положение дел.

Информация полна, если её достаточно для понимания и принятия решений. Как неполная, так и избыточная информация сдерживает принятие решений или может повлечь ошибки.

Точность информации определяется степенью ее близости к реальному состоянию объекта, процесса, явления и т.п.

Ценность информации зависит от того, насколько она важна для решения задачи, а также от того, насколько в дальнейшем она найдёт применение в каких-либо видах деятельности человека.

Только своевременно полученная информация может принести ожидаемую пользу. Одинаково нежелательны как преждевременная подача информации (когда она ещё не может быть усвоена), так и её задержка.

Если ценная и своевременная информация выражена непонятным образом, она может стать бесполезной.

Информация становится понятной, если она выражена языком, на котором говорят те, кому предназначена эта информация.

Информация должна преподноситься в доступной (по уровню восприятия) форме. Поэтому одни и те же вопросы, по разному излагаются в школьных учебниках и научных изданиях.

Информацию по одному и тому же вопросу можно изложить кратко (сжато, без несущественных деталей) или пространно (подробно, многословно). Краткость информации необходима в справочниках, энциклопедиях, учебниках, всевозможных инструкциях.

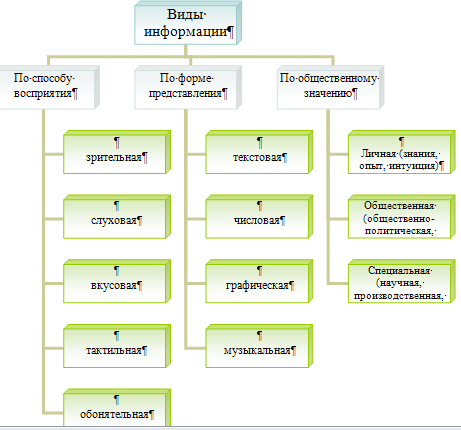

Виды информации.

Говорить об информации вообще, а не применительно к какому-то ее конкретному виду (роду, типу, классу) беспредметно.

Какие типы или виды информации можно выделить?

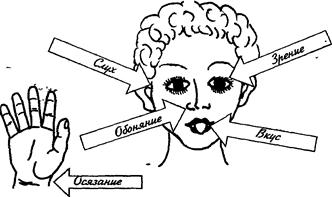

Во-первых, по способу восприятия информации.

У человека пять органов чувств:

Человек получает информацию о внешнем мире с помощью своих органов чувств. Практически около 90% информации человек получает при помощи органов зрения (визуальный), примерно 9% – при помощи органов слуха (аудиальный) и только 1% при помощи остальных органов чувств (обоняния, вкуса, осязания).

Во-вторых, по форме представления информации.

Рассмотрим только те виды информации, которые “понимают” технические устройства (в частности, компьютер).

Текстовая информация, например текст в учебнике, сочинение в тетради, реплика актера в спектакле, прогноз погоды, переданный по радио. Заметим, что в устном общении (личная беседа, разговор по телефону, радиопостановка спектакля) информация может быть представлена только в словесной, текстовой форме. Числовая информация, например таблица умножения, арифметический пример, счет в хоккейном матче, время прибытия поезда и др. В чистом виде числовая информация встречается редко, разве что на контрольных по математике. Чаще всего используется комбинированная форма представления информации.

Графическая информация: рисунки, схемы, чертежи, фотографии. Такая форма представления информации наиболее доступна, так как сразу передает необходимый образ (модель), а словесная и числовая требуют мысленного воссоздания образа. В то же время графическая форма представления не дает исчерпывающих разъяснений о передаваемой информации. Поэтому наиболее эффективно сочетание текста, числа и графики.

Музыкальная (звуковая) информация.

В настоящее время мультимедийная (многосредовая, комбинированная) форма представления информации в вычислительной техники становится основной. Цветная графика сочетается в этих системах со звуком и текстом, с движущимися видеоизображением и трехмерными образами.

В-третьих, по общественному значению информации.

Информация может быть:

Представим все рассмотренные виды информации в виде схемы:

В зависимости от типа носителя различают следующие виды информации:

Документальная информация представляется в графическом или буквенно-цифровом виде на бумаге, а также в электронном виде на магнитных и других носителях.

Речевая информация возникает в ходе ведения разговоров, а также при работе систем звукоусиления и звуковоспроизведения. Носителем речевой информации являются звуковые колебания в диапазоне частот от 200-300 Гц до 4-6 кГц.

Телекоммуникационная информация циркулирует в технических средствах обработки и хранения информации, а также в каналах связи при ее передаче. Носителем информации при ее обработке техническими средствами и передаче по проводным каналам связи является электрический ток, а при передаче по радио- и оптическому каналам – электромагнитные волны.

Источник информации может вырабатывать непрерывное сообщение (сигнал), в этом случае информация называется непрерывной, или дискретной – информация называется дискретной.

Например, сигналы, передаваемые по радио и телевидению, а также используемые в магнитной записи, имеют форму непрерывных, быстро изменяющихся во времени зависимостей. Такие сигналы называются непрерывными, или аналоговыми сигналами. В противоположность этому в телеграфии и вычислительной технике сигналы имеют импульсную форму и называются дискретными сигналами.

Сравнивая непрерывную и дискретную формы представления информации, нетрудно заметить, что при использовании непрерывной формы для создания вычислительной машины потребуется меньшее число устройств (каждая величина представляется одним, а не несколькими сигналами), но эти устройства будут сложнее (они должны различать значительно большее число состояний сигнала).

Информация, циркулирующая в обществе, требует специальных средств и методов обработки, хранения и использования. Сформировались новые научные дисциплины – кибернетика, бионика, робототехника и другие, имеющие своей целью изучение закономерностей информационных процессов.

Существует три подхода к измерению информации:

I подход – Неизмеряемость информации в быту (информация как новизна).

II подход – Технический или объемный (информация как сообщения в форме знаков или сигналов, хранимые, перерабатываемые и обрабатываемые с помощью технических устройств).

В вычислительной технике применяются две стандартные единицы измерения информации: бит и байт. Поскольку компьютер предназначен для обработки больших объемов информации, то используют производные единицы – килобайт (Кб), мегабайт (Мб), гигабайт (Гб). Обычно приставка «кило» означает тысячу, а приставка «мега» – миллион. Но в вычислительной технике осуществляется привязка к принятой двоичной системе кодирования.

В силу этого один килобайт равен не 1000 байтов, а 2 10 = 1024 байта.

Аналогично, 1 Мб = 2 10 Кб = 1024 Кб = 2 20 байтов = 1 048 576 байтов.

1 Гб = 2 10 Мб = 1024 Мб = 2 20 Кб = 2 30 байтов = 1 073 741 824 байта.

III подход – Вероятностный. Измерение информации в теории информации (информация как снятая неопределенность).

Получение информации (ее увеличение) означает увеличение знания, что, в свою очередь, означает уменьшение незнания или информационной неопределенности.

За единицу количества информации принимают выбор одного из двух равновероятных сообщений («да» или «нет», «1» или «0»). Она также названа битом.

2.1- Лекция Подходы к понятию информации и измер.информации

Тема 2.1 Подходы к понятию информации и измерению информации. Информационные объекты различных видов. Универсальность дискретного (цифрового) представления информации

(с сопровождением презентации)

С позиции человека информация – это содержание разных сообщений, это самые разнообразные сведения, которые человек получает из окружающего мира через свои органы чувств.

*Подходы к понятию информации

Функциональная концепция: Информация и информационные процессы присущи только живой природе, являются ее функцией

Антропоцентрическая концепция: Информация и информационные процессы присущи только человеку

*Существует два подхода к измерению информации:

*Содержательный (вероятностный) подход к измерению информации. Количество информации можно рассматривать как меру уменьшения неопределенности знания при получении информационных сообщений.

*За единицу количества информации принимается такое количество информации, которое содержится в информационном сообщении, уменьшающем неопределенность знания в два раза.

Бит – наименьшая единица измерения информации.

*С помощью набора битов можно представить любой знак и любое число. Знаки представляются восьмиразрядными комбинациями битов – байтами.

Байт – это 8 битов, рассматриваемые как единое целое, основная единица компьютерных данных.

*Рассмотрим, каково количество комбинаций битов в байте.

Если у нас две двоичные цифры (бита), то число возможных комбинаций из них:

Если четыре двоичные цифры (бита), то число возможных комбинаций:

0100, 0101, 0110, 0111,

1000, 1001, 1010, 1011,

1100, 1101, 1110, 1111

*Так как в байте- 8 бит (двоичных цифр), то число возможных комбинаций битов в байте:

2 8 =256 , т .о., байт может принимать одно из 256 значений или комбинаций битов.

*Для измерения информации используются более крупные единицы:

килобайты, мегабайты, гигабайты, терабайты и т.д.

1 Кбайт =1 024 байт

1 Мбайт = 1 024 Кбайт

1 Гбайт = 1 024 Мбайт

1 Тбайт = 1 024 Гбайт

*Проведем аналогию с единицами длины: если 1 бит «соответствует» 1 мм, то:

1 байт – 10 мм = 1см;

1 Кбайт – 1000 см = 10 м;

1 Мбайт – 10 000 м = 10 км;

1 Гбайт – 10 000 км (расстояние от Москвы до Владивостока).

Страница учебника содержит приблизительно 3 Кбайта информации;

1 газета – 150 Кбайт.

*Объемный (алфавитный подход) к измерению информации

Алфавитный подход позволяет измерить количество информации в тексте, составленном из символов некоторого алфавита.

*Алфавитный подход к измерению информации

Это объективный, количественный метод для измерения информации, циркулирующей в информационной технике.

*Алфавит- множество символов, используемых для представления информации.

*Например, алфавит десятичной системы счисления – множество цифр- 0,1,2,3,4,5,6,7,8,9.

Мощность этого алфавита – 10.

Алфавит двоичной системы кодирования информации имеет всего два символа- 0 и 1.

Алфавиты русского и английского языков имеют различное число букв, их мощности – различны.

* Информационный вес символа ( количество информации в одном символе ), выраженный в битах ( i ), и мощность алфавита ( N ) связаны между собой формулой:

где N – это количество знаков в алфавите знаковой системы или мощность

Тогда информационный вес символа:

В латинском алфавите 26 букв. Информационная емкость буквы латинского алфавита также 5 битов.

*Количество информации в сообщении или информационный объём текста- Ic, равен количеству информации, которое несет один символ-I, умноженное на количество символов K в сообщении:

*Информационные объекты различных видов

*Информационный объект – обобщающее понятие, описывающее различные виды объектов; это предметы, процессы, явления материального или нематериального свойства, рассматриваемые с точки зрения их информационных свойств.

Простые информационные объекты :

звук, изображение, текст, число.

Комплексные (структурированные) информационные объекты :

элемент, база данных, таблица, гипертекст, гипермедиа.

обладает определенными потребительскими качествами (т.е. он нужен пользователю);

допускает хранение на цифровых носителях;

допускает выполнение над ним определенных действий путем использования аппаратных и программных средств компьютера.

Пакеты мультимедийных презентаций

СУБД – системы управления базами данных

Клиент-программа электронной почты

Электронные письма, архивы, адресные списки

Программа-обозреватель Интернета (браузер)

Web -страницы, файлы из архивов Интернета

* Универсальность дискретного (цифрового) представления информации.

* Текстовая информация дискретна – состоит из отдельных знаков

Для обработки текстовой информации на компьютере необходимо представить ее в двоичной знаковой системе. Каждому знаку необходимо поставить в соответствие уникальный 8-битовый двоичный код, значения которого находятся в интервале от 00000000 до 11111111 (в десятичном коде от 0 до 255).

* Дискретное (цифровое) представление графической информации

Изображение на экране монитора дискретно. Оно составляется из отдельных точек- пикселей.

Пиксель — минимальный участок изображения, которому независимым образом можно задать цвет.

* В процессе дискретизации могут использоваться различные палитры цветов. Каждый цвет можно рассматривать как возможное состояние точки.

Пример

Наиболее распространенными значениями глубины цвета при кодировании цветных изображений являются 4, 8, 16 или 24 бита

на точку.

Можно определить количество цветов в 24-битовой палитре: N = 2 I = 2 24 = 16 777 21бит.

* Дискретное (цифровое) представление звуковой информации

Частота дискретизации звука — это количество измерений громкости звука за одну секунду.

Глубина кодирования звука — это количество информации, которое необходимо для кодирования дискретных уровней громкости цифрового звука.

Если известна глубина кодирования, то количество уровней громкости цифрового звука можно рассчитать по формуле

* Дискретное (цифровое) представление видеоинформа

Способ уменьшения объема видео: первый кадр запоминается целиком (ключевой), а в следующих сохраняются только отличия от начального кадра (разностные кадры).

Основные подходы к определению понятия “информация”

Как вы уже поняли из предыдущих параграфов:

1.Атрибутисты полагают, что информация как семантическое свойство материи является неотъемлемым атрибутом всех элементов и систем объективной реальности, она существовала и существует вечно.

3.Антропоцентристы ограничивают сферу информации главным образом социальными системами и определяют ее как содержание (смысл) сигнала, полученного системой из внешнего мира.

Просмотр содержимого документа

«Основные подходы к определению понятия “информация”»

1.3. ОСНОВНЫЕ ПОДХОДЫ К ОПРЕДЕЛЕНИЮ ПОНЯТИЯ “ИНФОРМАЦИЯ”

Как вы уже поняли из предыдущих параграфов:

в науке существует три подхода к феномену информации

Атрибутисты полагают, что информация как семантическое свойство материи является неотъемлемым атрибутом всех элементов и систем объективной реальности, она существовала и существует вечно.

Антропоцентристы ограничивают сферу информации главным образом социальными системами и определяют ее как содержание (смысл) сигнала, полученного системой из внешнего мира.

Все точки зрения имеют право на существование и исследуются в соответствующих областях науки: информация как семанитческое свойство материи изучается в философии, информациологии, физике; информация как функция управления изучается в кибернетике, физиологии, биологии; информация как содержание воспринятого сигнала изучается в лингвистике, социологии, психологии.

Сравните следующие определения понятия “информация” и определите, какое общее свойство информации в них отмечается и в чем состоят различия.

Чтобы лучше понять, о чем идет речь, представьте себе, что Вас поместили в темную комнату, стены, пол и потолок которой сделаны из одинакового материала, в которой не слышно ни одного звука, температура постоянна. Вокруг Вас все неизменно. Человек не может долго выдержать такое состояние однообразия, неизменности. Установлено, что если кого-либо полностью лишить информации об окружающем мире, лишить всякого восприятия, то он очень скоро почувствует себя крайне неуютно. После нескольких дней лишения всех ощущений он не сможет выполнять самые простые движения, например, такие, как взять стакан.

Мы привыкли к тому, что мир вокруг нас изменчив, мы и замечаем его именно в процессе изменения, то есть информация возникает, когда, нарушается однообразие и это нарушение каким-то образом отражается, проявляет себя в сигналах.

Все ли сигналы внешнего мира несут информацию для вас? Конечно же, нет. Два человека вместе идут по улице, но “видят” они ее по-разному. Один замечает (воспринимает и осознает) все проезжающие мимо автомобили, а второй обращает внимнание на собак и котов. Попросите рассказать их, что они видели, и вы услышите описание совершенно различных “улиц”.

В журналистике под информацией понимают не любые сообщения, а только те из них, которые обладают новизной.

В теории связи под информацией принято понимать любую последовательность сигналов, которая хранится, передается или обрабатывается с помощью технических средств, не учитывая их смысл.

В кибернетике под информацией понимается только та часть сообщения, которая участвует в управлении.

Итак, в информатике информацию можно рассматривать как продукт взаимодействия данных и адекватных им методов обработки.

Поскольку взглядов на феномен информации, видимо, столько же, сколько людей, существуют и другие ее определения.

Под информацией в философии понимают отраженное разнообразие, возникающее в результате взаимодействия объектов.

Под информацией в быту (житейский аспект) понимают сведения об окружающем мире и протекающих в нем процессах, воспринимаемые человеком или специальными устройствами (С.И.Ожегов. Толковый словарь русского языка).

Под информацией в технике понимают сообщения в форме знаков или сигналов, хранимые, передаваемые и обрабатываемые с помощью технических устройств.

Под информацией в кибернетике (теории управления) понимают ту часть знаний, которая используется для ориентирования, активного действия, управления, то есть в целях сохранения, совершенствования, развития системы (Н. Виннер).

Под информацией в семантической теории (смысл сообщения) понимают сведения, обладающие новизной.

Под информацией в документалистике понимают все то, что так или иначе зафиксировано в знаковой форме в виде документов.

В информатике информацию можно рассматривать как продукт взаимодействия зарегистрированных сигналов (ланных) и адекватных методов их обработки.

Информация нужна человеку не вообще, а конкретно в нужное время для ориентирования в окружающем мире и принятия решений о своих дальнейших действиях.

Сформулируйте, какое общее свойство информации и какая отличительная ее особенность для каждой отрасли науки отмечается во всех приведенных определениях этого понятия.

Какое определение понятия “информация” дали бы Вы?

Проанализируйте следующие объекты и ситуации с точки зрения различных подходов к определению понятия информация. Что можно считать информацией в этих ситуациях?

Основные подходы к определению

Сведения, хранящиеся в форме сигналов

Данные + методы обработки

Фотография наскальных рисунков

Пограмма, хранящаяся в памяти компьютера

Письмо, отправленное по электронной почте

Является ли информацией для Вас сведения, содержащиеся в библиотеке затонувшей Атлантиды или, хотя бы, в библиотеке конгресса США.

Получаете ли Вы информацию при повторном прочтении книги, учебника.

РАСШИРЬ СВОЙ КРУГОЗОР

Впервые как научное понятие термин “информация” стал применяться в теории журналистики в 30-х годах нашего века, хотя в исследованиях по библиотечному делу он появился еще раньше. Под информацией понимались разнообразные сведения, сообщения. Затем его “взяла на вооружение” наука об оптимальном кодировании сообщений и передачи сигналов по техническим каналам связи.

В основанной американским ученым Клодом Шенноном математической теории информации (

1948 год) под информацией понимались не любые сведения, а лишь те, которые снимают полностью или уменьшают существующую до их получения неопределенность (неизвестность). Каждому сигналу в теории Шеннона соответствует вероятность его появления (например, при передаче текста телеграммы вероятность появления буквы “Р”

1/32). Чем меньше вероятность появления того или иного сигнала, тем больше информации он несет для потребителя. В обыденном понимании чем неожиданнее новость, тем больше ее информативность. Была предложена и формула для вычисления количества информации в передаваемом сообщении.

Но математическая теория информации не охватывает всего богатства содержания информации, поскольку она отвлекается от содержательной (смысловой, семантической) стороны сообщения. С точки зрения этой теории фраза в 100 слов из газеты, пьесы Шекспира или теории Эйнштейна имеют приблизительно одинаковое количество информации.

Советский математик Ю. Шрейдер предложил оценивать информацию по увеличению объема знаний у человека под воздействием информационного сообщения. Академик А.А. Харкевич предложил измерять содержательность информации по увеличению вероятности достижения цели после получения информации человеком или машиной.

Данная концепция отрицает существование информации в неживой природе, не дает ответы на вопросы являются ли информацией неиспользуемые знания, является ли неосмысленные (как в ЭВМ) данные информацией. Для преодоления этих трудностей академик В.П. Афанасьев ввел понятие информационных данных. Информационные данные — это всякие сведения, сообщения, знания. Они могут хранится, перерабатываться, передаваться, но характер информации они приобретают лишь тогда, когда получают содержание и форму, пригодную для управления и используются в управлении.

В отличие от абстрактно мыслящих математиков и логиков инженеры, а также биологи, генетики, психологи и др. отождествляют информацию с теми сигналами, импульсами, кодами, которые наблюдаются в технических и биологических системах.

В социальных науках (социологии, психологии, политологии и др.) под информацией понимаются сведения, данные, понятия, отраженные в нашем сознании и изменяющие наши представления о реальном мире. Эту информацию, передающуюся в человеческом обществе и участвующую в формировании общественного сознания, называют социальной информацией.